Importer un compte GCP

Pour importer un compte de stockage GCP, vous devez créer un compte de service ayant accès au stockage et créer une paire de clés pour le compte.

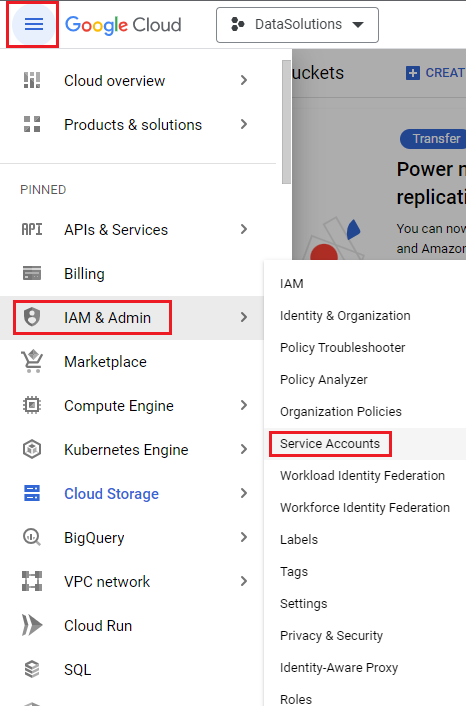

Dans le menu principal de Google Cloud, sous la section IAM & Admin, naviguez jusqu'à Comptes de service.

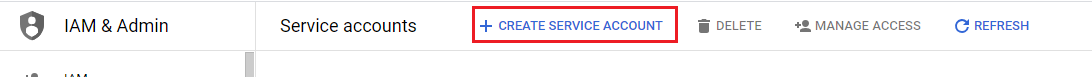

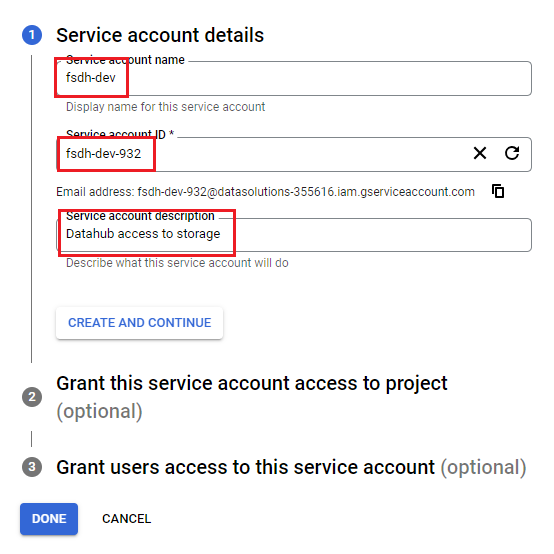

En haut de l'écran, cliquez sur Créer un compte de service et remplissez les informations relatives au compte. L'identifiant du compte de service est généré automatiquement par défaut, mais vous pouvez le générer à nouveau ou saisir manuellement la valeur de votre choix.

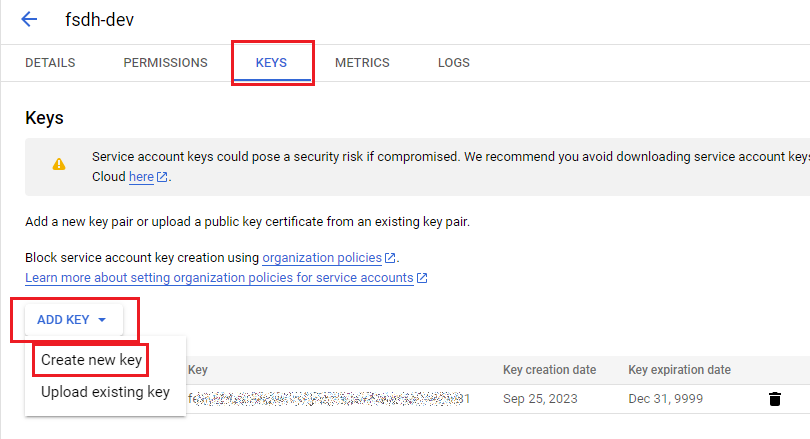

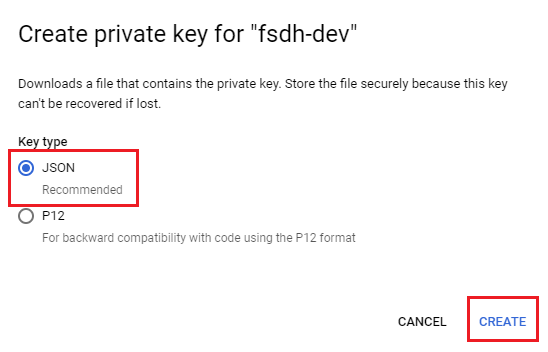

Après avoir créé l'utilisateur, cliquez sur son nom d'utilisateur dans la liste et accédez à l'onglet Keys. À partir de là, cliquez sur le bouton Add Key (Ajouter une clé) et sélectionnez Create new key (Créer une nouvelle clé). À l'invite, assurez-vous que JSON est sélectionné et cliquez sur le bouton Créer. Cela créera un fichier .json et le téléchargera sur votre ordinateur.

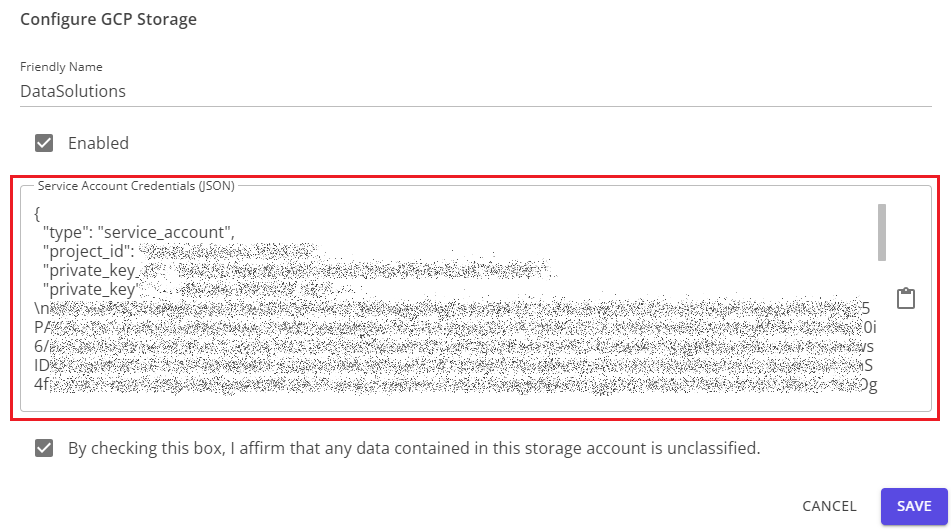

Pour importer le compte GCP dans Datahub, ouvrez le fichier .json dans un éditeur de texte et collez le contenu dans la zone de texte Service Account Credentials (JSON) dans Datahub.